Le développement et l'utilisation des technologies peuvent amener les entreprises à causer ou à contribuer aux droits de l'Homme et à d'autres préjudices sociaux et environnementaux. Par exemple, les biais dans les ensembles de données et l'apprentissage automatique peuvent conduire à des pratiques d'embauche discriminatoires, tandis que les algorithmes utilisés dans les plateformes en ligne peuvent manipuler les consommateurs et les électeurs en favorisant la diffusion de la désinformation, sans parler des technologies permettant de porter atteinte à la vie privée, telles que la surveillance généralisée et le contrôle invasif de l'activité des travailleurs.

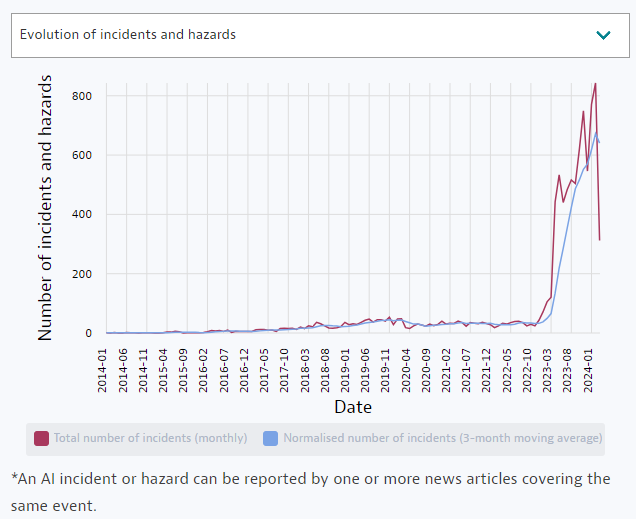

Les dangers de l'intelligence artificielle (IA) en particulier ont attiré l'attention des entreprises et des décideurs politiques ces dernières années. En réponse à ces préoccupations, l'accent est mis de plus en plus sur une IA responsable et digne de confiance, y compris la promotion de cadres éthiques, de lignes directrices et de normes pour le développement et l'utilisation de l'IA.

L'OCDE collabore avec un réseau d'experts multipartite afin d'élaborer des orientations sur le devoir de diligence en matière de conduite responsable des entreprises dans le cadre du développement et de l'utilisation de systèmes d'IA dignes de confiance.